El “lado oscuro” de la innovación: Inteligencia Artificial generativa y sus efectos en el medio ambiente

Recientemente, Google publicó la última versión de su informe ambiental, en el cual se revela que la empresa ha registrado un aumento del 48% en sus emisiones de carbono, en comparación con 2019, a raíz de los avances realizados en Inteligencia Artificial (IA). En este sentido, cabe recalcar que la IA generativa, como es el caso de ChatGPT, necesita de una gran cantidad de recursos, tanto computacionales, como naturales, para poder generar contenido nuevo a partir de datos de entrada. Por lo mismo, para su correcto funcionamiento se requiere de una gran potencia informática, lo que ha obligado a distintas empresas del área de las tecnologías a mejorar todo lo relacionado con la capacidad de procesamiento. En este artículo te contamos más al respecto.

¿Cómo puedo ayudarte hoy? Aquella pregunta es lo primero que leemos al entrar a ChatGPT (Generative Pre-trained Transformer), una aplicación de inteligencia artificial (IA) desarrollada en 2022 por OpenAI, la que llegó para revolucionar y redefinir el panorama de la comunicación digital y la forma de hacer las cosas.

«ChatGPT, junto con otras aplicaciones similares, vino a revolucionar a través de un paradigma nuevo de la inteligencia artificial, que se suma a los que ya había, que se llama la inteligencia artificial generativa. Esta viene a cambiar una lógica que al comienzo parte muy similar: le suministro conocimientos y datos a la máquina, pero en esta ocasión las máquinas, en vez de aprender a discernir, lo que hacen es aprender a generar datos nuevos y sintéticos, que se parecen lo más posible a lo que se tenía antes en términos de información», nos explica John Atkinson, doctor en Inteligencia Artificial (IA) de la Universidad de Edimburgo, en Escocia.

El objetivo de un modelo de lenguaje, como lo es ChatGPT, es prever lo que seguirá en un cuerpo de texto. Para aquello, primero debe ser entrenado. Esto se traduce en que el modelo debe ser expuesto a grandes cantidades de datos, los que provienen de Internet, libros, artículos, papers, redes sociales, entre otras fuentes de conocimiento. Este proceso puede tardar semanas o incluso meses, y llegar a repetirse en varias ocasiones a lo largo del tiempo.

Sin embargo, pese a que se ha transformado en una herramienta muy útil para la gran mayoría de los seres humanos, la realidad es que existe un “lado oscuro” en lo que respecta a su utilización, relacionado con los efectos negativos que produce en el medio ambiente.

«Hoy en día la inteligencia artificial generativa tiene un costo energético tan grande que es muy difícil encontrar aplicaciones donde la mejora en sustentabilidad de los sistemas supere los gastos de la misma tecnología», afirma Gonzalo Bustos, doctor en ingeniería química y master en energía sustentable, perteneciente al Centro Nacional de Inteligencia Artificial (Cenia).

«Lo que significa tener uno de estos modelos en producción, pasando por todas las etapas de entrenamiento y después en la etapa de inferencia, que es cuando uno lo utiliza, el gasto energético es mucho mayor de lo que me puedo ahorrar al usarlos», agrega.

De acuerdo con un estudio realizado por investigadores de las universidades estadounidenses de Riverside (California) y Arlington (Texas), el desarrollo de GPT-3 consumió alrededor de unos 700.000 litros de agua. Esta cantidad sería suficiente para producir 370 automóviles BMW o 320 vehículos eléctricos Tesla.

Asimismo, por cada conversación que se tiene con este modelo de lenguaje, de 20 a 50 preguntas aproximadamente, se consume una botella de medio litro de agua. Esto último puede parecer poco, pero si consideramos que la aplicación supera los 100 millones de usuarios activos, el consumo de agua al mes es de alrededor de 50 millones de litros, aunque no es posible saberlo con precisión por la poca transparencia que existe en torno a los datos por parte de la empresa.

«Cuando las grandes empresas usan supercomputadores, estos se sobrecalientan demasiado, y la única manera de que no pase eso y se reduzca un poco el gasto, es manteniendo la temperatura. Aquello implica un proceso de congelamiento, el que utiliza agua, la que hay que congelar para mantener los sistemas. La pregunta del millón es de dónde se saca esa agua. Esto está dejando sin agua a la gente», señala Atkinson.

«Más críticamente, la demanda mundial de IA puede ser la responsable de la extracción de agua de 4.2 a 6.6 mil millones de metros cúbicos en 2027, lo que es más que la extracción anual total de agua de Dinamarca o la mitad del Reino Unido. Esto es muy preocupante, ya que la escasez de agua dulce se ha convertido en uno de los desafíos más urgentes que compartimos todos a raíz del rápido crecimiento de la población, el agotamiento de los recursos hídricos y el envejecimiento de las infraestructuras hídricas», se lee en el estudio titulado Making AI Less «Thirsty».

Sumado a lo anterior, debemos tener en cuenta que, en general, para el funcionamiento de aquellos dispositivos que utilizan IA, se necesitan centros de datos extremadamente potentes, por lo que para mantenerlos también se consume una gran cantidad de electricidad.

En este sentido, en la actualidad estos centros consumen cada vez más energía. De acuerdo con una investigación realizada recientemente, en 2022 se registró un consumo de 460 TWh de electricidad y, según la Agencia Internacional de la Energía (AIE), se espera que para 2026 la cifra supere los 1.000 TWh.

«Se habla de GPU, que son las unidades de procesamiento gráfico, que son en el fondo el procesador que se utiliza para entrenar este modelo. Si en la computadora, en la laptop, estamos acostumbrados a tener una GPU, para entrenar el modelo de inteligencia artificial de ChatGPT, en la versión 3, se tuvieron que utilizar 10.000 GPU. Cada GPU, en términos de potencia energética, consume 250 watts. Una ampolleta de las viejas era de 100 watts, es decir, en equivalencia serían 25.000 de estas ampolletas, prendidas todo el día durante casi un mes», comenta Bustos.

«En promedio en Chile un hogar consume 2 megawatts-hora al año. Si eso lo comparamos con estas 25.000 ampolletas, que equivale a 1560 megawatts-hora, entonces, haciendo una división rápida, el entrenamiento de ChatGPT 3 equivale al consumo de electricidad anual de 800 familias chilenas», agrega.

Es así como, un sistema de IA generativo, como es el caso de ChatGPT, utiliza entre 10 y 33 veces más energía que las máquinas que ejecutan un software para tareas específicas.

Como resultado de todo lo mencionado, la producción de estos modelos es bastante costosa, tanto económicamente, gracias al costo del hardware y la electricidad, como ambientalmente, debido a la huella de carbono que se genera al alimentar los equipos de procesamiento de manera continua.

Respecto a esto último, autores de un estudio publicado por Cornell University estimaron que, al entrenar a un solo modelo de lenguaje, como ChatGPT, se necesitan alrededor de 300.000 kg de emisiones de dióxido de carbono. Esto es igual a lo que producen 125 vuelos de ida y vuelta entre Nueva York y Pekín.

El caso de Google

El buscador más usado en todo el mundo, Google, encabeza la lista de los gigantes tecnológicos, de la cual forman parte otras empresas sumamente famosas en el área, tal como es el caso de Microsoft, Amazon y Apple. Al igual que ellas, Google ha realizado una notable inversión en lo que respecta a la integración de la IA en sus servicios.

«Es toda una industria donde hay un incentivo para generar cada vez modelos más grandes, más poderosos. Entonces, el problema no es que haya un solo modelo ChatGPT 3 entrenándose, el problema es que hay cientos de modelos equivalentes que están todas las semanas siendo entrenados para alcanzar nuevas aplicaciones», señala Bustos.

Como ya mencionamos con anterioridad, la IA generativa, aquella que incluye tecnologías que le permiten crear contenido nuevo a partir de datos de entrada, necesita de una gran cantidad de recursos, tanto computacionales, como naturales. Por lo mismo, la necesidad de mayor potencia informática ha obligado a la empresa a mejorar todo lo relacionado con la capacidad de procesamiento.

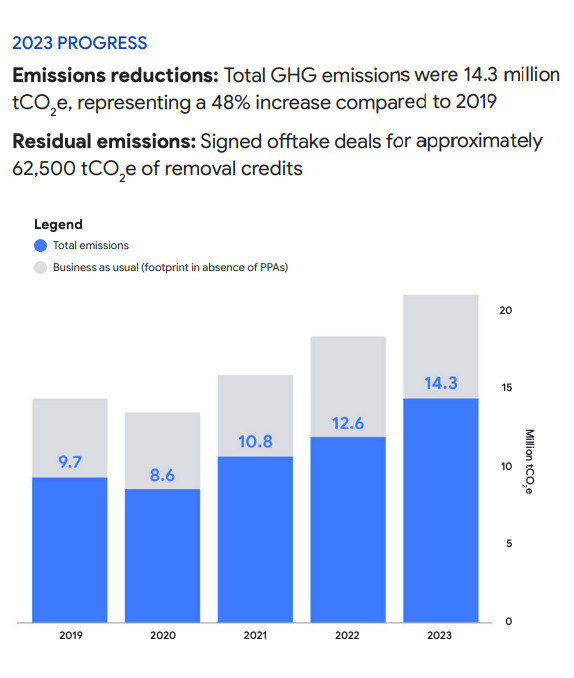

A partir de esa base, Google lanzó recientemente su último informe medioambiental, en el cual se revela que la empresa ha registrado un aumento del 48% en sus emisiones de carbono en comparación con 2019. Es más, solo en 2023 el aumento fue de un 13% respecto al 2022.

«Me imagino que gran parte de este aumento, del 50% en 5 años, es porque muchas empresas de Inteligencia Artificial ocupan los servicios de Google, y Google en sí mismo también desarrolla sus propios modelos de inteligencia artificial», comenta Bustos al respecto.

En este sentido, durante el año pasado las emisiones de efecto invernadero de Google se tradujeron en cerca de 14,3 millones de toneladas de CO₂. Una cifra alarmante y poco esperanzadora, equivalente a la que pueden liberar 38 centrales eléctricas de gas en un año, considerando que la empresa se había propuesto llegar a las cero emisiones netas de carbono en 2030.

El diagnóstico de Microsoft tampoco es alentador, debido a que sus emisiones de CO₂ aumentaron un 29% en estos tres últimos años. Asimismo, Amazon decidió aplazar su meta de neutralidad del 2030 al 2040.

Sin embargo, no todo es negativo, ya que Google se ha dedicado a invertir en una serie de medidas con el objetivo de que sus centros de datos sean más eficientes. Algunas de ellas son: la adopción de nuevas técnicas de entrenamiento de algoritmos, la integración de chips de procesamiento y mecanismos avanzados de enfriamiento de servidores, la compra de electricidad renovable, la creación de un innovador modelo de IA hidrológico global, entre otras más.

«Para ayudar a minimizar nuestra huella ambiental, hemos construido una infraestructura líder mundial en eficiencia para la era de la IA. Esto incluye Trillium, nuestra Unidad de Procesamiento Tensor (TPU) de sexta generación, que es un 67% más eficiente energéticamente que la TPU v5e. También hemos identificado prácticas testeadas que, según nuestra investigación, pueden reducir hasta 100 veces la energía necesaria para entrenar un modelo de IA y hasta 1.000 veces las emisiones asociadas, cuando se utilizan en conjunto. Todas estas prácticas son implementadas actualmente en Google», se lee en el último informe medioambiental de la empresa.

«Nos esforzamos por construir la infraestructura informática más eficiente energéticamente del mundo, respaldada por prácticas responsables de uso del agua y un compromiso con la minimización de residuos. Un centro de datos propiedad y operado por Google es en promedio aproximadamente 1.8 veces más eficiente energéticamente que un típico centro de datos. En 2023, la efectividad promedio anual del uso de energía (PUE) de nuestros centros de datos fue de 1.10, en comparación con el promedio de la industria de 1.58. Esto significa que nuestros centros de datos utilizaron aproximadamente 5.8 veces menos energía adicional por cada unidad de energía consumida por los equipos informáticos», agregan.

Lamentablemente, los avances se han ido dando de forma paulatina y únicamente por la motivación de los privados, ya que no existen normas que los obliguen a comprometerse de forma directa con la sustentabilidad, por lo que algunas empresas del rubro no se han mostrado tan dispuestas a ser parte de esta colaboración.

«Las grandes empresas como Google, Microsoft, IBM, Amazon, tienen cierta estrategia de carbono neutralidad donde están comprometidas a reducir sus emisiones, por lo tanto, a buscar fuentes de energía renovables para alimentar todos sus centros de datos y toda su maquinaria para procesar esta información, y para entrenar modelos de inteligencia artificial. En el caso de ChatGPT, que es de OpenAI, no tengo claridad, porque no he encontrado información, de que sea abierto en transparentar cuáles son sus contratos de suministro eléctrico. No sabemos de dónde viene esa electricidad», explica Bustos.

La IA pensada de forma sustentable

La inteligencia Artificial, incluidas todas sus áreas y paradigmas, tiene un potencial valioso para impulsar la acción climática. Es más, de acuerdo con Google, podría ayudar a mitigar entre el 5% y el 10% de las emisiones globales de gases de efecto invernadero (GEI) para 2030.

«Lo primero es mejorar la tecnología en sí, y lo segundo sería buscar aquellas aplicaciones donde el beneficio o el impacto positivo sea mayor que el costo. En esa búsqueda de aplicaciones, tenemos que enfocarnos en aquellos sectores de la industria, o de la economía, que sabemos que tienen mayor impacto ambiental, y enfocar los esfuerzos de descarbonización, que son los sectores de transporte, de energía y agricultura», afirma Bustos.

«Si uno ve las cifras del año 2019, respecto a las emisiones a nivel global, casi el 32% proviene del sector electricidad y calefacción, luego un 15% de transporte, un 12% de agricultura, y un 13% en la manufactura y construcción. Debemos utilizar esta tecnología de Inteligencia Artificial para justamente hacer que estos sectores sean más sustentables», agrega.

En este sentido, la IA también puede impactar de manera positiva no solo en el planeta, sino que también en las fábricas y en los hogares. Si se mejora su eficiencia energética, la IA podría ayudar incluso a reducir las emisiones de gases de efecto invernadero en los edificios, al controlar elementos como la iluminación y la temperatura interna.

También puede aplicarse en la elaboración de diferentes bienes, como es el caso de los automóviles, en la reducción del consumo de la cadena de suministros y en el manejo de los residuos. Del mismo modo, puede ser útil para el diseño de redes inteligentes, el desarrollo de infraestructuras de bajas emisiones y la modelización de predicciones sobre el cambio climático.

«Una de las cosas que tú puedes hacer con este cambio paradigmático de la inteligencia artificial es resolver problemas complejos para la humanidad. Estos van desde lo más doméstico, como lo es una aspiradora robot, que optimiza todo lo que es la limpieza de la casa, hasta la implementación de sistemas ambientales y económicos, que optimicen los recursos de tal forma que se haga uso de ellos de forma eficiente, en pro del medio ambiente», señala Atkinson.

«Se destacan los modelos que hay, que son muy buenos, que te permiten predecir condiciones ambientales. Entonces, no solamente tú podrías regular lo que está sucediendo en este momento, sino que también podrías tomar medidas de prevención», agrega.

Un ejemplo de esto último es el nuevo centro de la Universidad de Columbia, Learning the Earth with Artificial Intelligence and Physics (LEAP), el cual se encuentra desarrollando modelos climáticos basados en IA de próxima generación y capacitando a estudiantes en el campo.

Sin embargo, hay que ser conscientes de que, aunque se produzcan avances en el uso de energía limpia en muchas partes donde se encuentran estos centros de datos, existen regiones que se presentan como un reto inminente en lo respectivo a la descarbonización. Un ejemplo de esto es Asia Pacífico, donde la energía libre de carbono (CFE) no está disponible fácilmente.

«Un futuro sostenible requiere cambios a nivel del sistema, políticas gubernamentales sólidas y nuevas tecnologías. Estamos comprometidos con la colaboración y con desempeñar nuestro rol en cada paso del camino», sentencia Google al final de su informe medio ambiental.